世界模型:Masked / JEPA 与潜变量预测

这页回答一个初学者很容易忽略的问题:世界模型为什么不总是直接预测像素?

如果目标是生成视频,像素或视频 latent 当然重要;但如果目标是规划和控制,模型真正需要保留的是会改变动作选择的变量:物体位置、运动趋势、接触、遮挡、任务阶段、奖励、风险和终止。Masked / JEPA 路线的价值,就是把训练压力从逐像素复原转向更抽象、更稳定的 latent 或 embedding。

Masked / JEPA 可以提高表示效率和样本效率,但原始形式通常还不包含 action、reward、done 和 closed-loop 消费接口。要成为可规划世界模型,还必须接 action-conditioned dynamics、risk/reward heads 和闭环评测。

1. 为什么不直接预测像素

像素预测有一个好处:监督信号密集,输出直观。但它对世界模型也有明显副作用。

| 像素预测容易花容量在 | 对决策是否关键 | 可能的问题 |

|---|---|---|

| 背景纹理、光照、阴影 | 通常不关键 | 模型很会画,但不会判断动作风险 |

| 局部细节 | 有时关键,有时是噪声 | 接触和物体状态被纹理误差淹没 |

| 平均未来 | 对多模态未来很危险 | 杯子可能左滑或右滑,平均后变成不真实状态 |

| 高分辨率输出 | 控制主链路常承受不起 | 每个候选动作都解码视频太慢 |

所以高效世界模型常走一条更务实的路线:

1 | 先学视觉 / 视频 latent |

这不是否定像素视频。可视化、人审、数据回流和生成式模拟仍然需要视频输出。关键是:控制主路径不一定要逐帧生成高清未来。

2. 四种训练目标对照

| 目标 | 简化 loss | 输入输出 | 省下什么 | 不能证明什么 |

|---|---|---|---|---|

| Pixel reconstruction | 输入上下文,输出像素 | 监督直接,可视化方便 | 像素准不等于会选动作 | |

| Token / latent reconstruction | 输入可见 token,预测遮挡 latent | 降低输出维度 | latent 是否保留 reward/risk 仍需验证 | |

| Joint-embedding prediction | context encoder 预测 target encoder 表征 | 不需要像素 decoder | 原始 JEPA 不含动作、奖励、终止 | |

| Action-conditioned latent dynamics | 输入 latent 和动作,输出未来 latent/reward/done | 在低维状态里比较候选动作 | 多步漂移和模型漏洞仍会伤闭环 |

可以把它理解成学习阶梯:pixel reconstruction 证明模型能看见,latent prediction 证明模型能压缩,JEPA 证明模型能预测抽象结构,action-conditioned dynamics 才开始回答“如果我这样做,会发生什么”。

3. MWM:先压视觉,再学 dynamics

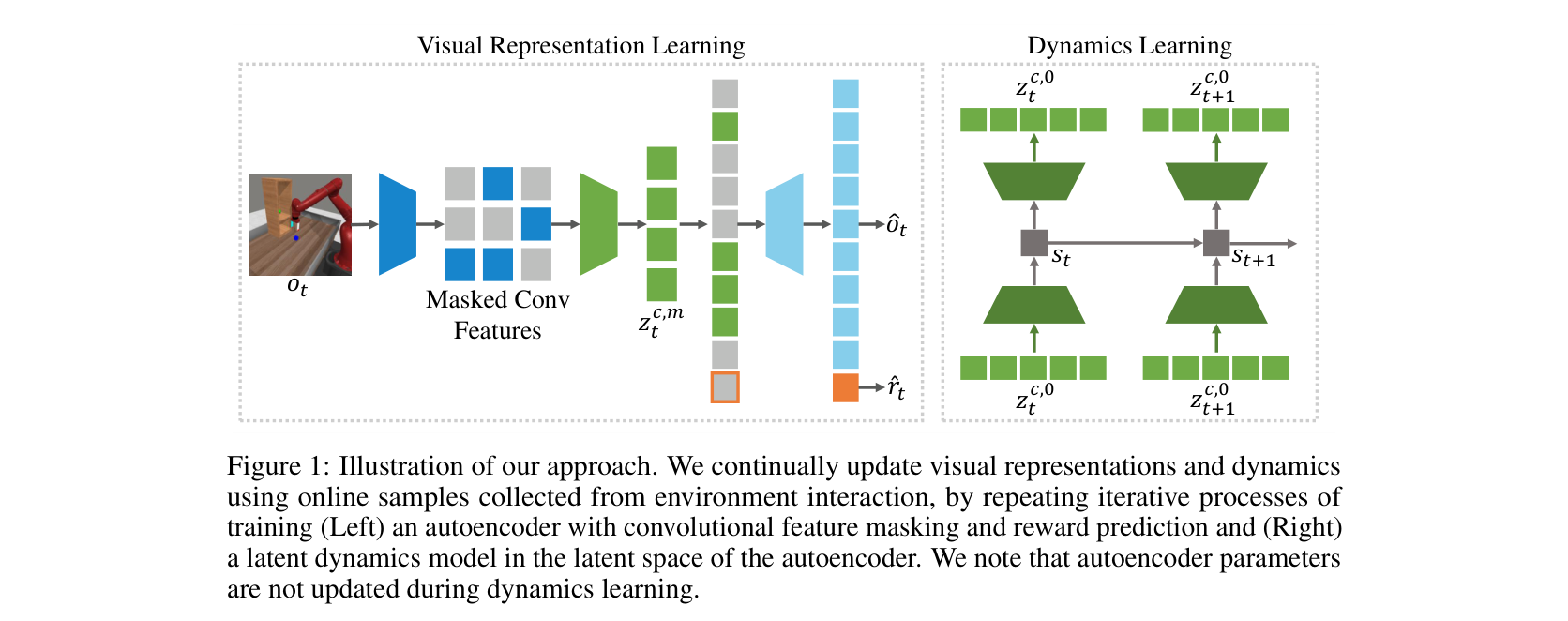

Masked World Models for Visual Control 的核心思路是把视觉表征和 dynamics 解耦:先用 masked convolutional features 训练视觉 autoencoder,并加入 reward prediction;再冻结或解耦这个表示,在 latent space 中训练 dynamics model。

图源:Masked World Models for Visual Control,Figure 1。原图意:左侧用 masked convolutional features 训练视觉 autoencoder,并预测 reward;右侧在 autoencoder latent space 中训练 latent dynamics,且 dynamics learning 阶段不更新 autoencoder 参数。

输入输出:左边输入图像 ,输出重建观测和 reward;右边输入 latent、动作历史和 stochastic state,输出下一步 latent。

关键模块:masked visual representation 负责“看懂并压缩”,latent dynamics 负责“动作后果”。

公式对应:左边近似 ,右边接近 。

容易误读:MWM 不是说 masked reconstruction 本身已经会规划,而是说更好的视觉表征能让后续 dynamics 更省样本。

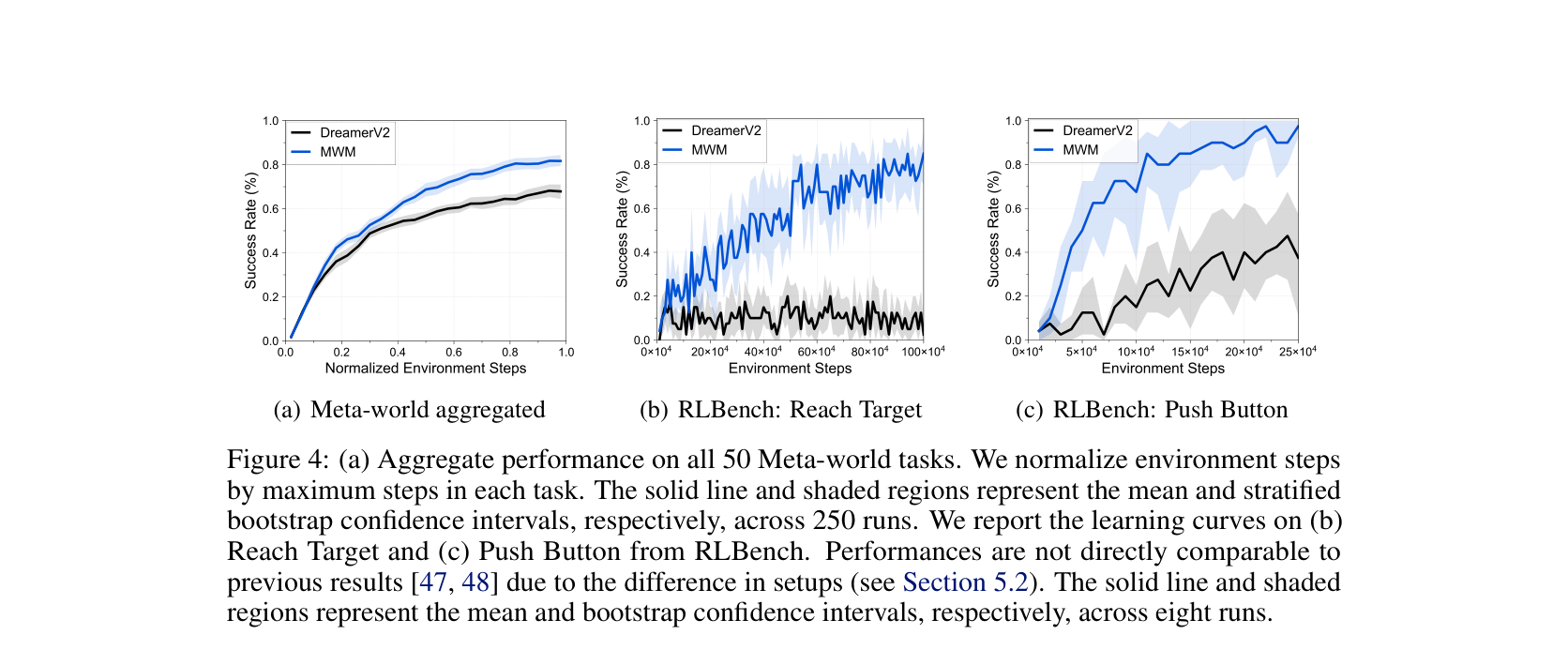

图源:Masked World Models for Visual Control,Figure 4。原图意:展示 MWM 与 DreamerV2 在 Meta-world aggregate、RLBench Reach Target 和 RLBench Push Button 上的 success rate 学习曲线。

输入输出:横轴是环境交互步数,纵轴是成功率;曲线比较同等真实交互下的学习速度。

关键模块:如果 MWM 曲线更快上升,说明 masked representation + latent dynamics 在这些视觉控制设置中提高样本效率。

公式对应:不是单纯看重建 loss,而是看 representation 是否改善 downstream control。

容易误读:这组结果不能外推为“所有 masked model 都能真实机器人闭环规划”。

Figure 4 是论文设置下的 Meta-world / RLBench paper result。它支持“MWM 在这些视觉控制任务中改善样本效率”,但不能证明任意视频世界模型都应优先用 MWM,也不能替代 action sensitivity 和真实部署评测。

4. V-JEPA:预测 latent,不画回像素

V-JEPA 的关键转向是:让模型预测 target encoder 产生的 latent representation,而不是用 decoder 把被遮挡区域逐像素画回来。这样可以减少对低层纹理的依赖,把容量更多放在对象、运动和场景结构上。

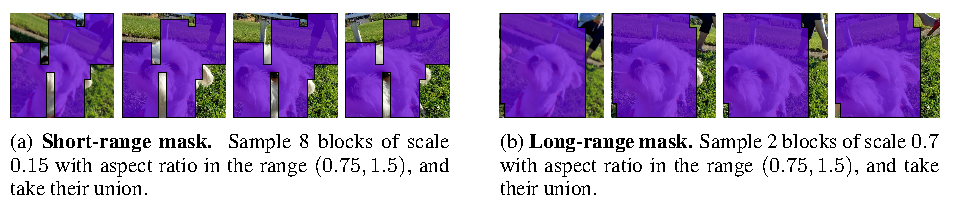

图源:V-JEPA: Latent Video Prediction for Visual Representation Learning,Figure 2。原图意:在视频时空体上采样多个 3D block mask,让 context encoder 只能看到部分时空区域。

输入输出:输入是一段视频 token grid,mask 遮住多个时空块,模型从可见上下文预测被遮挡区域的 target latent。

关键模块:mask 不只是遮几个像素,而是在时间和空间上遮结构块,迫使模型利用运动和对象关系。

公式对应: 是可见上下文, 是被遮挡目标。

容易误读:会补全遮挡 latent 不等于懂动作后果,因为这里还没有动作 。

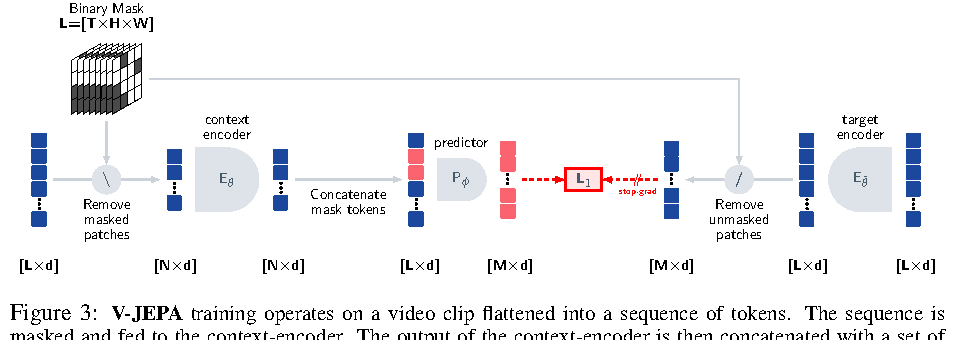

图源:V-JEPA: Latent Video Prediction for Visual Representation Learning,Figure 3。原图意:context encoder 处理 masked sequence,predictor 用 learnable mask tokens 预测目标位置,target encoder 处理未遮挡完整输入并提供 latent target。

输入输出:context encoder 只看可见 token;target encoder 看完整视频并提供 stop-gradient latent;predictor 输出 masked positions 的预测表示。

关键模块:target encoder 像老师,context encoder 和 predictor 像学生;学生不画像素,只追目标表征。

公式对应:。

容易误读:V-JEPA 是 internal representation 路线,不是直接可交互视频模拟器。

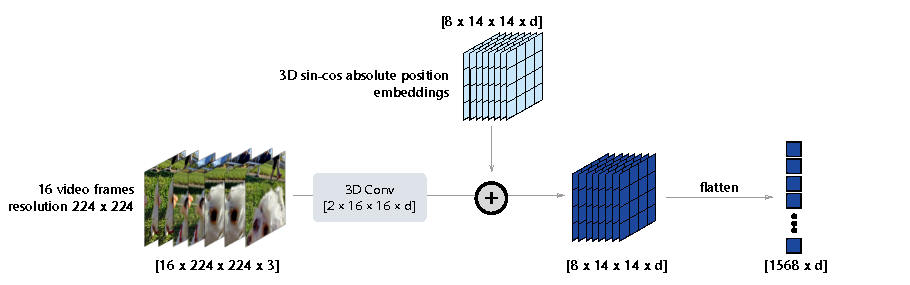

图源:V-JEPA: Latent Video Prediction for Visual Representation Learning,Figure 4。原图意:展示视频如何被切分成时空 token,并通过 encoder/predictor 进入 latent prediction 目标。

输入输出:连续视频先变成时空 token,再进入 encoder 和 predictor;输出是目标 token 的 latent。

关键模块:tokenization 决定上下文长度,latent prediction 决定输出维度。

公式对应:视频 token 是 到 的前置压缩接口。

容易误读:token 更少不等于控制更好;必须检查接触、遮挡、风险和动作敏感性是否保留。

5. V-JEPA 2-AC:从表征预测走向动作条件规划

V-JEPA 2-AC 更接近世界模型主线,因为它把视频自监督表征接到 action-conditioned predictor,并用 MPC/CEM 搜索动作序列,使未来 latent 接近目标图像 latent。

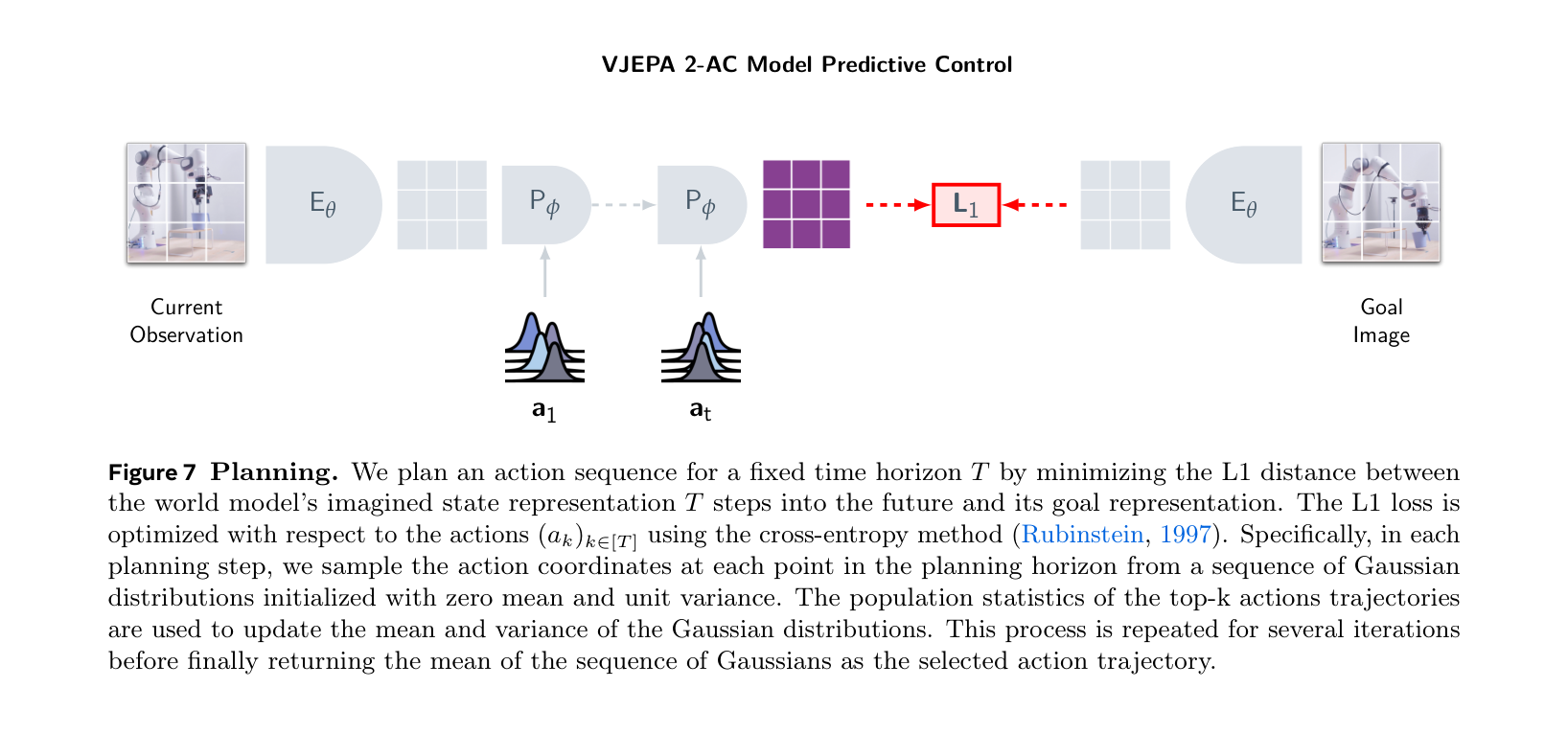

图源:V-JEPA 2: Self-Supervised Video Models Enable Understanding, Prediction and Planning,Figure 7。原图意:在 V-JEPA 2-AC 中,对候选动作序列做 model predictive control,让 imagined state representation 在未来 步后接近 goal representation。

输入输出:输入当前观测、目标图像和候选动作序列;模型在 latent space 里 rollout,输出未来表示并与目标表示比较。

关键模块:action-conditioned predictor 把动作放进 latent dynamics,MPC/CEM 在候选动作中搜索。

公式对应:从 前进到 。

容易误读:它证明的是特定机器人设置中的 representation-space planning,不是所有 JEPA 表征天然可规划。

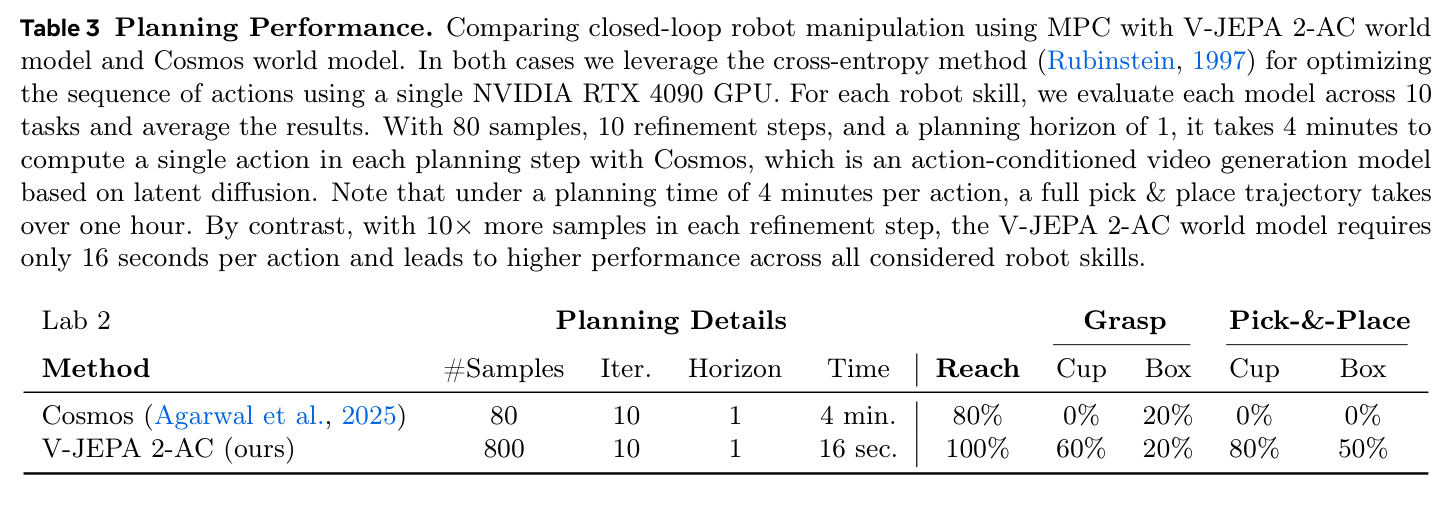

图源:V-JEPA 2: Self-Supervised Video Models Enable Understanding, Prediction and Planning,Table 3。原图意:比较 V-JEPA 2-AC 与 Cosmos world model 在机器人操作任务中的规划性能与时间。

输入输出:表格报告不同方法在机器人任务中的规划结果和时间成本。

关键模块:这里的证据比 frozen eval 更接近世界模型,因为它包含 closed-loop planning 设置。

公式对应:模型输出未来 latent 后,planner 选择让未来 latent 更接近目标的动作。

容易误读:表格不是跨平台通用控制结论,仍受目标图像、动作空间、任务集和硬件设置限制。

6. 什么时候它还不是完整世界模型

| 情况 | 为什么不够 | 需要补什么 |

|---|---|---|

| 只有 masked image/video reconstruction | 学到视觉补全,不一定学到动作后果 | action-conditioned dynamics、反事实动作评测 |

| 只有 JEPA 表征 benchmark | 表征好不等于能规划 | reward/done/risk heads、closed-loop policy 或 MPC |

| 只报告 FVD/VBench/demo | 视频自然度和 planning utility 不是同一指标 | action sensitivity、candidate ranking agreement |

| latent 太压缩 | 省 token 但可能丢接触、透明物体、遮挡身份 | task-state probing、failure replay、hard-negative eval |

| mask 或 tokenizer 只在静态数据上验证 | 静态泛化不能覆盖控制分布 shift | offline-online hybrid、真实 rollout 回流 |

7. 工程选择

| 需求 | 优先路线 | 原因 |

|---|---|---|

| 机器人/游戏样本效率,已有 reward/done | RSSM / Dreamer / MWM | 直接围绕 latent dynamics 和 control signal 优化 |

| 大规模视频预训练,缺少动作 | V-JEPA / H-JEPA | 先学稳定视频表征,再接动作头 |

| 目标图像驱动规划 | V-JEPA 2-AC / MPC | 在 representation space 比较候选动作与目标 |

| 需要生成可检查视频反事实 | action-conditioned video world model | 需要外部模拟和人类/系统审查 |

| 实时闭环控制 | latent dynamics + 短 horizon refresh | 优先压延迟和 drift,而不是追求像素质量 |

8. Claim Ledger

| Claim | Source | Evidence Type | Can Support | Cannot Prove |

|---|---|---|---|---|

| MWM 在论文设置中通过 decoupled representation + dynamics 改善视觉控制样本效率 | MWM | Paper Result | masked visual representation 可以服务 model-based visual control | 任意 masked model 都能 closed-loop 规划 |

| V-JEPA 通过 latent target prediction 避免部分像素重建成本 | V-JEPA | Ablation | joint-embedding prediction 是高效视频表征预训练路线 | 原始 V-JEPA 已经包含动作、奖励和终止建模 |

| V-JEPA 2-AC 把 JEPA 表征接到动作条件 latent planning | V-JEPA 2 | Closed-loop | 表征空间 MPC 可以在特定机器人设置中执行目标驱动任务 | 跨平台通用控制、长时风险规划和真实部署安全性 |

9. 接回主线

读完这页后,回到 RSSM、Dreamer 与规划 看 latent dynamics 如何真正进入 actor-critic;再读 WM / WAM / VAM,判断动作是条件、输出还是和世界未来联合生成;最后用 世界模型评测与失效模式 检查表征是否真的改善决策。

- Title: 世界模型:Masked / JEPA 与潜变量预测

- Author: Charles

- Created at : 2026-04-20 09:00:00

- Updated at : 2026-04-20 09:00:00

- Link: https://charles2530.github.io/2026/04/20/ai-files-world-models-masked-jepa-and-latent-prediction/

- License: This work is licensed under CC BY-NC-SA 4.0.