世界模型:数据引擎与自我改进

世界模型的长期价值,不只在于一次训练出一个“会想象未来”的模型,而在于它能否成为持续收集数据、发现盲点、生成新经验并反哺策略的核心引擎。换句话说,世界模型不仅是预测器,也可能是数据调度器、失败分析器、样本筛选器和反事实生成器。

这页讨论世界模型如何与主动采样、失败回流、near-miss 挖掘、仿真生成、人工反馈和门禁验证结合,形成持续演化的学习系统。前置概念见 世界模型路线图 和 模拟器、反事实与合成 Rollout。

世界模型做数据引擎时,重点不是“生成更多数据”,而是发现哪里最不确定、哪些失败最有信息量、哪些反事实最值得验证。

教练不会随机重看所有录像,而会重点看差点摔倒、差点撞人、动作变形的片段。世界模型数据引擎也应优先挖 near-miss 和失败分支。

硬证据模块:数据引擎不能只说“回流更多”

数据引擎页最需要硬证据,因为“回流失败样本”听起来永远正确,但实际可能把模型偏差越喂越大。每一次数据回流都应该能写成一张证据卡。

| 证据项 | 最小记录 | 验收指标 | 反例 |

|---|---|---|---|

| 本轮解决哪项成本 | 少采真实交互、少人工标注、少无效 rollout 中的哪一项 | 每新增 1 小时数据带来的目标桶收益 | 总数据量变大,但 hard bucket 不变好 |

| 样本为什么被选中 | uncertainty、near-miss、risk false negative、planner disagreement | 被选样本的信息密度高于随机采样 | 模型只挑自己会生成的样本,覆盖更窄 |

| 失败 replay | 输入、动作候选、预测风险、真实结果、人工标签 | 失败能定位到感知、动作、risk 或控制器 | 只有 success=false,无法训练具体头 |

| 回流前后对比 | 固定 eval bucket 的旧模型/新模型结果 | 目标失败类型下降,不引入新安全问题 | 平均成功率升,高风险 false negative 也升 |

| 数据门禁 | 合成/想象样本是否经过真实性和可执行性过滤 | 被拒样本比例、人工抽检一致率 | 合成 rollout 直接回流,形成自我强化 |

最小可复算的形式可以很小:4 条 hard episode、12 个候选动作、一个脚本算出 top-1 safe success 和 failure replay。关键是它要能证明“为什么这条失败值得回流”。例如 fast_grasp -> slip 应回流到 risk head 和接触事件桶;grasp_visible_decoy -> wrong_target 应回流到遮挡 memory 和多相机对象身份桶。两者都不应该只作为普通失败视频混进随机采样。

为什么世界模型适合做数据引擎

相比纯策略模型,世界模型显式学习状态如何演化,因此更容易回答“哪里不会、为什么不会、该补什么数据”。

它可以评估哪些状态区域最不确定,想象不同动作会导向什么未来,在离线环境中筛选高价值轨迹,从失败轨迹中定位错误传播起点,生成反事实轨迹来分析“如果当时换个动作会怎样”,并区分“看起来异常”和“对决策真的重要”。

普通日志回流通常只能告诉你哪里失败了;世界模型还可能告诉你哪一步开始进入危险分支,哪种动作能降低风险,哪些 near-miss 虽然没有事故却最值得优先回流。

闭环结构

一个典型数据引擎闭环是:先收集真实交互轨迹 ,训练或更新世界模型 ,再用 评估不确定性、价值或失败模式;随后选择下一批采样任务或生成候选轨迹,获得新数据 ,并合并更新到 。

形式上可以写成:

其中 是主动数据采集策略。关键点不在“闭环”这个词,而在选择机制:哪些日志最值得回流,哪些失败最有信息量,哪些想象轨迹值得人工复核,哪些数据应该被拒绝进入训练集。

真实系统里通常有三个闭环并行存在:

| 闭环 | 关注点 | 典型数据 |

|---|---|---|

| 模型闭环 | 世界模型预测哪里差 | 高误差 rollout、不确定状态、模型分歧 |

| 策略闭环 | 策略在哪些任务上退化 | 失败轨迹、恢复轨迹、边界任务 |

| 安全闭环 | 哪些状态接近失控 | near-miss、人工接管、风险触发日志 |

这三者优先级未必一致。成熟数据引擎必须在模型收益、策略收益、安全收益和采集成本之间做预算分配。

主动采样与预算分配

在机器人和自动驾驶里,真实交互昂贵,因此要优先采那些最可能提升系统的数据。世界模型可以把 ensemble 分歧、rollout 误差预测、value / risk head 不稳定性、成功率边界附近的高敏感区、不同 planner 的动作建议冲突、新旧模型在同一状态上的预测偏移,以及反事实动作导致的未来差异,都当成信息价值的近似信号。

若某状态-动作对的信息价值为 ,可以优先采:

但实际系统还要考虑成本。不同数据源单位成本不同,真实机器人采样、驾驶 shadow mode、高保真仿真、世界模型 imagined rollout、人工演示和人工修正不可能无限采。一个概念上的预算分配是:

这里 是预期收益, 是单位成本。数据引擎不只是“会挑样本”,还要会在成本约束下挑样本。

失败回流与 Near-Miss

成功轨迹多告诉你系统的舒适区,失败轨迹和 near-miss 才真正暴露能力边界。世界模型在失败回流里有两个独特作用:判断失败从哪一步开始不可逆偏离,并在失败附近生成反事实轨迹,比较“如果当时换个动作会怎样”。

失败样本最好不要只做成功/失败二元标注,而应分层:

| 类型 | 价值 |

|---|---|

| 完全成功 | 维持主分布和行为稳定性 |

| 成功但过程不稳 | 发现效率和鲁棒性问题 |

| Near-miss | 处在风险边界,信息密度高 |

| 可恢复失败 | 学习恢复策略和容错 |

| 不可恢复失败 | 定义安全边界和回退规则 |

| 人工接管 | 暴露系统不应自主执行的区域 |

Near-miss 往往最值钱,因为它同时具备风险高、可学习、数量比真实事故多的特点。它比纯事故更适合训练风险头、恢复策略和保守模式,因为系统还处在“来得及修正”的边界带上。

反事实与合成 Rollout

世界模型可以在失败或高风险状态附近提出反事实问题:如果提前减速会怎样,如果换抓取角度会怎样,如果不变道而等待会怎样,如果工具调用延后一步会怎样,如果从人工接管前一刻开始重新规划会怎样。这些 imagined rollouts 可以帮助人类标注关键决策点,为 planner 提供候选动作比较,生成训练数据候选,做安全策略的离线门禁,也可以构造课程学习中的边界样本。

但合成数据必须经过门禁。常见检查包括动作可执行性、物理/逻辑一致性、风险标签可信度、与真实分布距离、是否会放大模型自身偏差。世界模型生成的数据如果未经验证直接回流,很容易形成自我强化的幻觉闭环。

在线与离线两套闭环

离线闭环和在线闭环要分开设计。

| 闭环 | 更适合做什么 | 风险 |

|---|---|---|

| 离线闭环 | 批量误差分析、版本对比、near-miss 挖掘、课程式重采样 | 指标好看但线上不稳定 |

| 在线闭环 | 高不确定触发额外观察、人工接管、保守模式、实时打标回流 | 误触发影响体验或安全 |

离线闭环适合大规模筛选和复盘,在线闭环适合风险控制和高价值样本捕获。两者共享同一套数据资产,但验收标准不同:离线重在信息增益和覆盖,在线重在安全、延迟和可回退。

门禁与评估

数据引擎是否有效,不能只看“新增了多少数据”。更关键的是新增数据是否改善了目标能力,并且没有污染训练分布。

建议同时看新增样本中 near-miss、可恢复失败和长尾场景占比,通过门禁的合成数据比例,回流数据对目标 bucket 的能力提升,主分布能力是否退化,风险率、接管率和恢复成功率是否改善,世界模型不确定性是否更校准,以及数据采集成本是否被有效降低。

具体场景:从一条抓取失败日志到回流数据

假设仓储机械臂任务是“从透明周转箱里抓取反光金属瓶盖”。线上日志里有这样一条 episode:

1 | { |

这条日志不能直接丢进训练集。数据引擎要先把它拆成可判断的桶:

| 字段 / 观察 | 分桶 | 为什么有训练价值 |

|---|---|---|

human_takeover 且 min_dist=1.2cm |

near-miss / 可恢复失败 | 还没事故,但已经接近不可恢复分支 |

wm_risk_before_action=0.18 |

风险低估 | risk head 对反光物体过度自信 |

top_grasp 后物体旋转 |

接触动力学失败 | 未来状态不是“夹住或没夹住”,而是滑移/旋转 |

| operator note 指向反光边缘 | 感知状态失败 | 需要补反光材质、深度噪声和边缘不确定性 |

一个实用的信息价值分可以写得很朴素:

对这条样本,假设四项分别是 0.9 / 0.8 / 0.6 / 0.7,综合分约 0.76,进入高优先级回流。但门禁仍会拒绝一部分相似样本:

| 样本类型 | 处理 | 原因 |

|---|---|---|

多机位时间戳漂移超过 80ms |

拒绝进入训练,只进排障队列 | 视频和动作不同步会污染 action-conditioned supervision |

| 深度图大面积 invalid 且无 RGB 可判定边缘 | 只做人审,不做自动监督 | 标注目标状态不可信 |

同一箱体、同一位置、同一失败重复 >20 次 |

聚类后降采样 | 防止单一背景和物体位置过采样 |

| 世界模型反事实与真实回放冲突大 | 进入 counterfactual review | 可能暴露模型漏洞,不能直接把合成未来当真值 |

回流后不应只看“新增多少条”。更有含金量的验收是:

| 指标 | 回流前 | 回流后目标 | 判断 |

|---|---|---|---|

| 反光金属 bucket 风险召回 | 61% |

>75% |

risk head 是否学会早报危险 |

| near-miss 人工接管率 | 14.2% |

<10% |

线上是否少进入边界分支 |

| 主分布 pick success | 93.5% |

不低于 93% |

回流不能牺牲常规任务 |

| 反事实排序准确率 | 68% |

>78% |

世界模型是否能区分 top grasp 和 side grasp |

这就是“数据引擎”比“多收失败样本”更具体的地方:日志先变成桶,桶再变成打分,打分通过门禁后进入训练,训练后必须在对应桶上验收。没有这条链,回流很容易变成把脏样本重新喂给模型。

从 LingBot-World 看三阶段数据飞轮

世界模型的数据引擎不能只理解成“多收点数据再训一次”。技术报告里更常见的是分阶段飞轮:先继承大规模视频先验,再用交互和长程数据补因果关系,最后用因果化、蒸馏和在线回放把模型推向可交互系统。

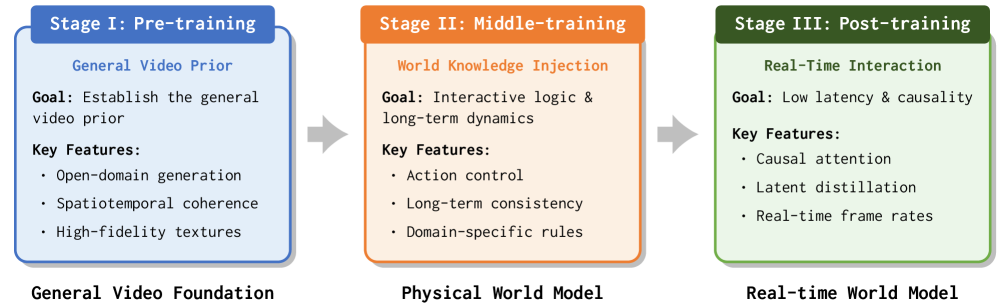

图源:Advancing Open-source World Models,Figure 4。原论文图意:LingBot-World 从 foundation video generator 出发,经过 pre-training、middle-training 和 post-training,逐步获得通用视频先验、交互逻辑/长时动态和低延迟因果交互能力。

第一阶段像给模型看海量世界录像,让它知道物体、场景和一般运动长什么样。第二阶段开始喂动作、相机、游戏或交互轨迹,让模型知道“做了什么会改变未来”。第三阶段才把系统约束放进来:因果注意力、KV cache、少步蒸馏、延迟预算和实时交互。世界模型的数据飞轮不是单一数据池,而是按能力阶段组织的数据供应链。

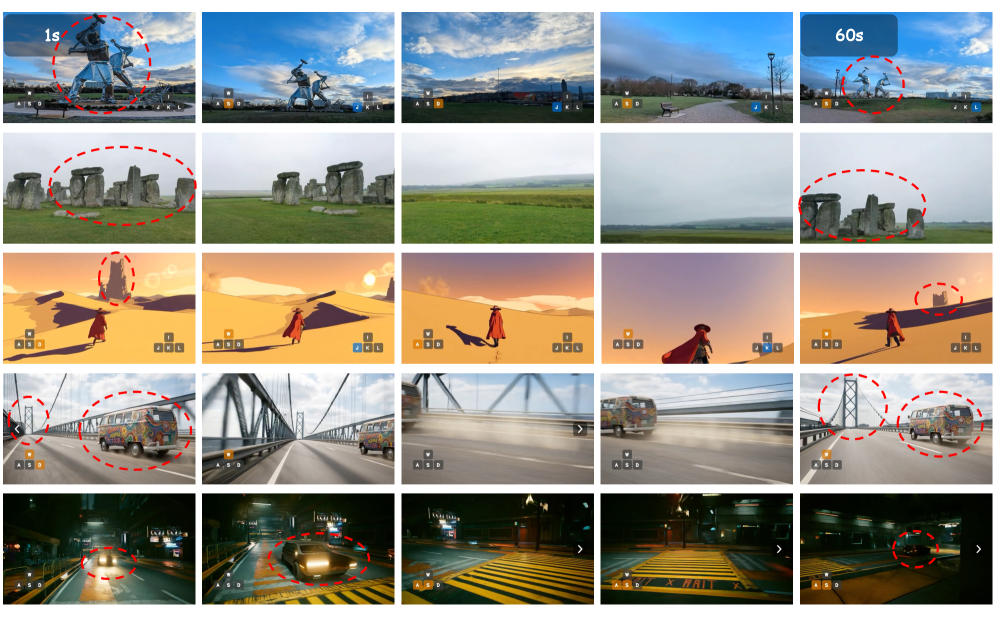

图源:Advancing Open-source World Models,Figure 12。原论文图意:展示模型在长时交互中保持空间记忆与历史一致性的能力。

长时记忆问题通常不会在短片段 loss 里暴露:模型可能 5 秒内看起来稳定,30 秒后忘记门开没开、物体放到哪里、之前绕过哪个障碍。数据引擎应该把“长时不一致、回到旧位置认错、状态记忆断裂”单独成桶,而不是只按视频质量或短期成功率回流。

这条线和 RSSM/Dreamer 的交互轨迹路线不同。RSSM/Dreamer 从一开始就把 observation-action-reward-done 当成训练核心;LingBot-World 这类视频路线先把“世界长什么样、会怎么动”的视觉先验学强,再补动作条件和交互逻辑。两条路线都需要数据回流,但回流重点不同:

| 路线 | 最值钱的回流数据 | 为什么 |

|---|---|---|

| RSSM / Dreamer | reward 错、done 错、动作后果错的轨迹 | 直接影响 policy 和 imagined rollout |

| 视频世界模型 | 动作不敏感、长时不一致、反事实错误的视频片段 | 决定模拟器是否真的可控 |

| Agentic 世界模型 | 工具轨迹失败、状态记忆错、恢复失败日志 | 决定多轮交互是否闭环 |

一个生动的判断是:如果模型只是把失败视频续写得很漂亮,它还没有完成自我改进;如果它能指出“从哪个动作开始未来变坏”,并帮助系统补采 near-miss、恢复轨迹和反事实样本,它才真正进入数据引擎角色。

世界模型数据引擎的目标不是无限扩数据,而是让每轮数据都更接近系统当前短板。只有当采集、生成、筛选、门禁、训练和评测形成闭环时,“自我改进”才不是口号。

- Title: 世界模型:数据引擎与自我改进

- Author: Charles

- Created at : 2026-04-26 09:00:00

- Updated at : 2026-04-26 09:00:00

- Link: https://charles2530.github.io/2026/04/26/ai-files-world-models-data-engines-and-self-improvement/

- License: This work is licensed under CC BY-NC-SA 4.0.