世界模型:从零理解世界模型

这页是世界模型专题的入口缓冲层。默认你已经知道神经网络、Transformer、token 和训练 loss 的大概意思,但还不熟 RL、RSSM、JEPA、WAM/VAM 和论文里的公式符号。

先把一句话放在前面:

世界模型不是“会生成未来视频”的模型,而是“能预测动作后果,并把这种预测交给 planner、policy、风险模块或数据引擎使用”的模型。

如果读后面的论文页时感到符号和缩写太密,先回到这页。这里的目标不是替代细节,而是给你一张不迷路的小地图。

1. 一个智能体循环

世界模型总是放在一个循环里理解。没有循环,它就容易被误读成普通生成模型。

flowchart LR

A["观测 observation

图像、文本、传感器历史"] --> B["内部状态 state / latent

把历史压成可预测的表示"]

B --> C["候选动作 action

抓取、转向、点击、轨迹"]

C --> D["世界模型 world model

预测未来、奖励、风险、终止"]

D --> E["planner / policy

选择下一步动作"]

E --> F["真实环境 environment"]

F --> A

这条环里有四个关键问题:

- 现在看到了什么:观测 或 。

- 内部相信世界处于什么状态:真实状态 不一定可见,模型常用 latent 或记忆 表示。

- 如果执行动作 ,未来会怎样:下一状态、未来观测、奖励、风险、是否终止。

- 谁使用这些预测:planner、policy、value model、risk checker、数据引擎或人类审查。

普通视频生成器通常只回答“接下来画面可能长什么样”。世界模型必须多回答一步:“换一个动作,未来会不会合理改变,并且这种改变能不能帮助选择动作?”

2. 先分清四个常见东西

| 名称 | 它回答的问题 | 常见输入 | 常见输出 | 初学者容易误读 |

|---|---|---|---|---|

| 视频生成器 | 未来看起来像什么 | 历史视频、文本、图像 | 未来帧或视频 | 画面自然不等于懂动作后果 |

| VLA policy | 现在应该做什么 | 视觉、语言、状态历史 | 动作 token、动作块、轨迹 | 会出动作不等于能预测动作后果 |

| Latent dynamics | 状态如何随动作演化 | latent、动作、历史记忆 | 下一 latent、reward、done | 不生成清晰视频也可能很有用 |

| 可规划世界模型 | 候选动作哪个更好 | 状态、目标、候选动作 | 未来、风险、价值、排序 | 关键是被 planner/policy 消费 |

所以 VLA 和世界模型不是同一个角色。VLA 更像“驾驶员”,世界模型更像“驾驶员脑中的可调用沙盘”。最强的系统常常会把两者接起来:policy 产生候选动作,world model 预测后果,planner 或 risk module 再决定是否执行。

3. 符号表:先把论文公式读顺

| 符号 | 读法 | 含义 | 小例子 |

|---|---|---|---|

| time step | 当前时间步 | 第 10 帧或第 10 次控制 | |

| sequence length | 一条训练序列总长度 | 64 帧历史 | |

| horizon | 向未来 rollout 的步数 | 预测未来 15 步 | |

| , | observation | 当前观测,常是图像、视频 token、传感器读数 | 机器人相机图像 |

| state | 理想的真实环境状态,通常不可完全观测 | 物体位置、速度、接触关系 | |

| latent state | 模型学到的压缩状态 | 一段向量或离散 token | |

| deterministic memory | RSSM 里的历史记忆 | 过去动作和观测的摘要 | |

| action | 当前动作 | 夹爪位移、方向盘角、点击按钮 | |

| reward | 奖励或任务进展 | 抓取成功加分 | |

| done | 终止或失败标记 | 撞墙、任务结束 | |

| continue | 未终止概率,常与 done 相反 | 还能继续 rollout 的概率 | |

| discount | 未来奖励折扣 | 越远的奖励权重越小 | |

| model distribution | 参数为 的预测模型 | prior、decoder、reward head | |

| inference distribution | 参数为 的后验推断模型 | 看见真实观测后的 belief | |

| policy | 参数为 的策略 | 根据 latent 输出动作 | |

| value function | 参数为 的价值函数 | 估计当前状态未来有多好 |

最常见的一行公式是:

它读作:给定当前 latent state 和动作 ,模型预测下一步 latent state 的概率分布。这里最重要的是动作 :如果动作不进入模型,或者进入了但不会改变预测,那它就很难成为对决策有用的世界模型。

4. 状态、观测和 latent 的区别

observation 是传感器看到的表面,state 是足以预测未来的真实局面,latent 是模型自己学出来的内部摘要。

举个机器人抓杯子的例子:

| 层级 | 可能包含什么 | 为什么不一样 |

|---|---|---|

| 观测 | 当前 RGB 图像、深度图、关节角 | 可能看不到杯子背面、速度和接触力 |

| 真实状态 | 杯子位置、速度、质量、摩擦、夹爪接触 | 这是理想信息,现实中很难完全知道 |

| 潜状态 | 神经网络学到的一组向量/token | 不必逐项对应物理量,但要保留决策相关信息 |

| 记忆 | 过去几帧、过去动作、遮挡前的信息 | 当前帧缺的信息可能藏在历史里 |

世界模型的难点就在这里:它必须从不完整观测中学出足够好的 latent,让未来预测和动作选择不被表面纹理牵着走。

5. 三个最小公式

5.1 动作条件转移

含义:动作之后,世界状态如何变化。

初学者要问:换一个 ,预测的 是否真的不同?

5.2 观测解码

含义:从 latent 还原或解释当前观测。

初学者要问:重建像素只是辅助,真正重要的是 latent 是否保留动作、奖励、风险需要的信息。

5.3 想象回报

含义:策略 在世界模型 里 rollout 步,累计未来奖励。

初学者要问:这个 imagined return 在真实环境里是否仍然可信?如果世界模型错了,policy 会利用这个错误。

6. 一张图理解 latent dynamics

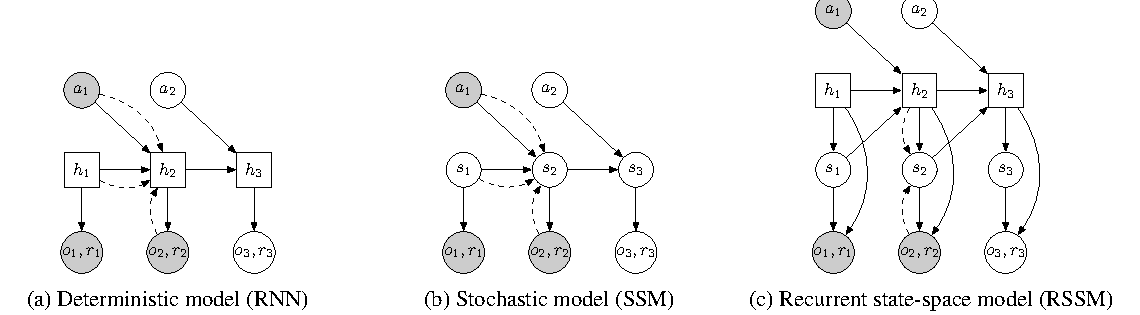

图源:Learning Latent Dynamics for Planning from Pixels,Figure 2。原论文图意:比较 RNN、SSM 和 RSSM 三种 latent dynamics 结构;RSSM 同时保留 deterministic memory 和 stochastic latent state。

输入输出:输入是历史 latent、历史动作和当前观测;输出是下一步 latent、重建观测和奖励预测。

关键模块: 负责记忆历史, 负责表达当前不确定性,prior 负责不看未来图像时向前预测,posterior 负责看到真实图像后修正 belief。

公式对应:,,。

容易误读:RSSM 不是为了把图像画得更清楚,而是为了在部分可观测环境里维护一个可 rollout 的 belief state。

7. 一张图理解 Dreamer

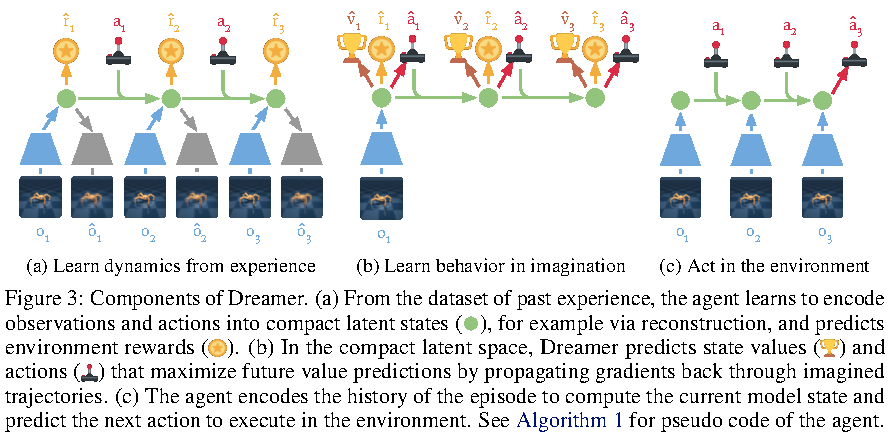

图源:Dream to Control: Learning Behaviors by Latent Imagination,Figure 3。原论文图意:Dreamer 从经验中学习 latent dynamics,再在 latent imagination 中训练 actor 和 value,最后回到真实环境执行动作。

输入输出:真实 episode 进入 replay buffer;world model 学 latent、reward 和 continuation;actor/value 在 imagined rollout 上更新。

关键模块:左边是学世界,中间是用世界训练行为,右边是真实执行并收集新数据。

公式对应:world model 学 ,actor 学 ,critic 学 。

容易误读:Dreamer 的价值不是“会生成视频”,而是把真实环境试错的一部分换成 latent imagination。

8. 三条主线怎么排顺序

建议按下面顺序读世界模型专题:

| 顺序 | 先解决什么困惑 | 对应页面 |

|---|---|---|

| 1 | 世界模型和 VLA、视频生成器有什么区别 | 本页、世界模型路线图 |

| 2 | latent state、RSSM、imagined rollout 是什么 | RSSM、Dreamer 与规划 |

| 3 | 为什么很多方法不直接预测像素 | Masked / JEPA 与潜变量预测 |

| 4 | WM、WAM、VAM 到底差在哪 | WM / WAM / VAM:动作条件建模 |

| 5 | 视频生成怎样变成可交互模拟 | 生成式模拟与视频世界模型 |

| 6 | 怎么证明模型真的有用 | 世界模型评测与失效模式 |

读任何新论文时,都可以固定问五个问题:

- 它建模的是像素、token、latent、动作、奖励、风险,还是完整轨迹?

- 动作 是输入、输出、条件变量,还是只在数据标签里出现?

- 模型输出被谁消费:planner、policy、risk checker、数据引擎,还是只给人看?

- 它的证据是 open-loop loss、benchmark 曲线、闭环任务、系统吞吐,还是 demo?

- 它不能证明什么:长时 rollout、真实机器人、安全部署、跨任务泛化,还是动作因果?

9. 一个最小验收标准

初学者最容易被漂亮视频或复杂公式带偏。一个简单但很有用的验收标准是:

1 | 固定同一段历史观测 |

如果只满足前两行,它可能是动作条件预测器。

如果还能给出可比较的风险和成功排序,它开始接近可规划世界模型。

如果接入真实闭环后成功率、恢复率或 cost per success 变好,才算进入工程证据层。

10. 接下来怎么读

读完本页后,先回到 世界模型路线图 看总览,再按 RSSM/Dreamer -> Masked/JEPA -> WM/WAM/VAM -> 生成式模拟 -> 评测 的顺序走。后面的页面会继续使用本页这套符号,不再每次重新解释 、、、 和 rollout。

- Title: 世界模型:从零理解世界模型

- Author: Charles

- Created at : 2026-05-09 09:00:00

- Updated at : 2026-05-09 09:00:00

- Link: https://charles2530.github.io/2026/05/09/ai-files-world-models-beginner-world-models-primer/

- License: This work is licensed under CC BY-NC-SA 4.0.